Nội dung

AI đang trở thành “người lắng nghe tâm sự” mới của nhiều người dùng, nhưng đằng sau sự thấu hiểu mô phỏng là hàng loạt rủi ro đáng lo ngại. Từ việc thu thập và lưu trữ dữ liệu nhạy cảm đến khả năng thao túng hành vi, bạn tâm giao AI này không chỉ đặt ra bài toán về đạo đức mà còn có thể trở thành mối đe dọa đối với sức khỏe tinh thần nếu không được kiểm soát chặt chẽ. Sự tiện lợi không thể thay thế cho sự đồng cảm thực sự, và niềm tin không thể trao trọn cho một hệ thống không có cảm xúc. Điều quan trọng không nằm ở việc AI có thể làm được gì, mà là con người có sẵn sàng đặt giới hạn cho nó hay không.

Đằng sau những sự tiện lợi sẽ luôn là một câu hỏi chưa có lời giải rõ ràng. Khi trí tuệ nhân tạo trở thành bạn tâm giao và tiếp cận cảm xúc thông qua dữ liệu, ranh giới giữa sự thấu hiểu và sự kiểm soát trở có khả năng trở nên cực kỳ mong manh. Vậy nên liệu việc sử dụng nguời bạn tâm giao AI này có phải là bước tiến vượt bậc trong việc hỗ trợ tinh thần hay chỉ là sự khởi đầu cho một cuộc khủng hoảng đến quyền riêng tư chưa từng có.

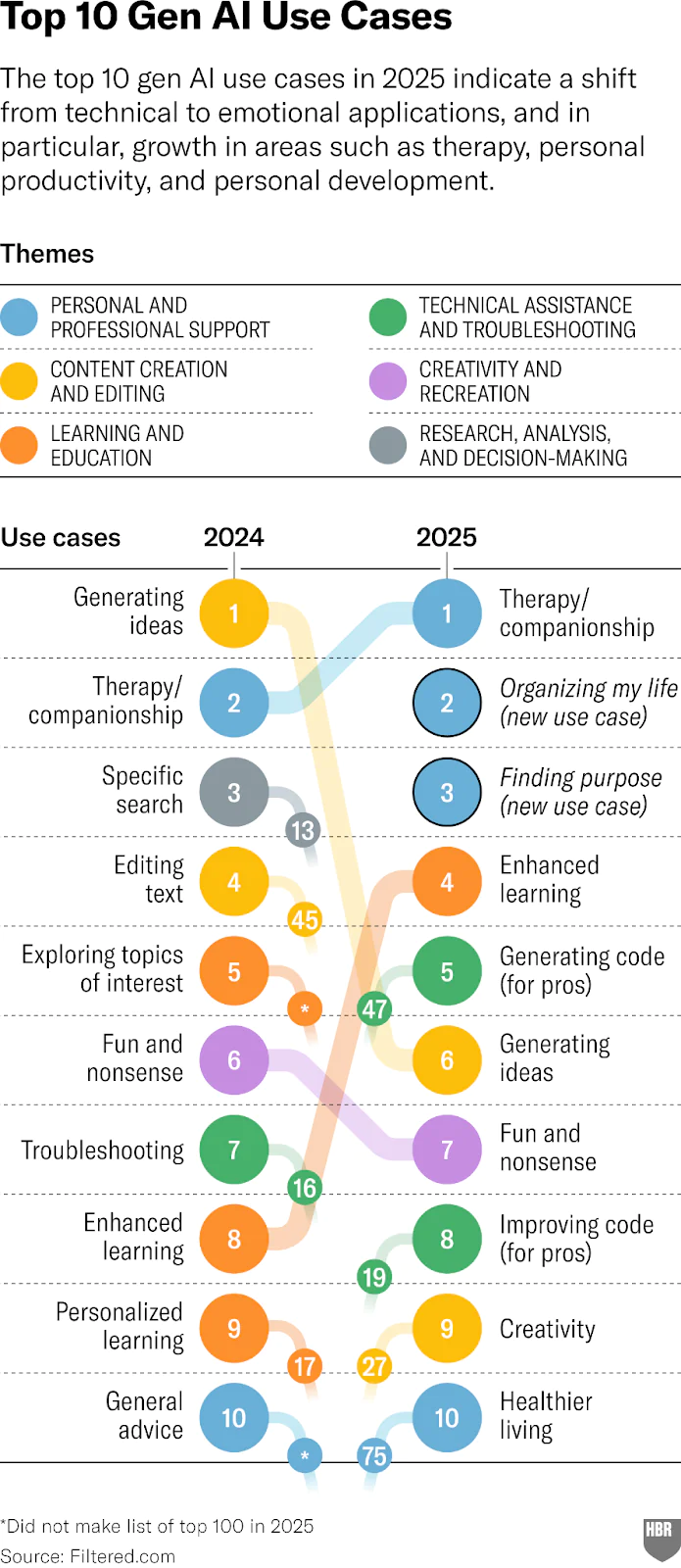

Sự phát triển nhanh chóng của trí tuệ nhân tạo (AI) đang mở ra một viễn cảnh mới cho lĩnh vực chăm sóc sức khỏe tinh thần. Giờ đây, con người có thể trò chuyện với AI ngay tại nhà mà không cần chờ đợi lịch hẹn với chuyên gia. AI trở thành một công cụ có khả năng lắng nghe liên tục, không phán xét, không mệt mỏi và luôn sẵn sàng hiện diện bất kỳ lúc nào người dùng cần. Khả năng phân tích cảm xúc ngày càng tinh vi kết hợp với cách phản hồi tự nhiên đã khiến AI được xem như một người đồng hành lý tưởng trong mắt nhiều người.

Khi con người không còn phải lý giải hay phòng vệ cảm xúc của mình, chúng ta bắt đầu tin tưởng và gắn bó với các công cụ AI này một cách vô thức. Sự hiện diện liên tục khiến những cuộc trò chuyện lúc ba giờ sáng không còn xa vời. Việc không có yếu tố con người khiến người dùng không cảm thấy bị quan sát hay đánh giá. Dần dần, AI trở thành một tấm gương phản chiếu cảm xúc và tạo ra cảm giác được thấu hiểu sâu sắc.

Tuy nhiên, AI không có khả năng cảm nhận như con người, cũng không thể đưa ra lời khuyên mang tính đồng cảm thực sự vì không dựa trên trải nghiệm cá nhân hoặc trực giác nhân văn. Chính điều đó làm nổi bật giới hạn của công nghệ trong lĩnh vực tâm lý: thiếu sự thấu cảm thật sự. Vậy cảm giác “được hiểu” mà người dùng cảm nhận từ AI có thực sự là thật, hay chỉ là kết quả của một quá trình mô phỏng tinh vi? Chúng ta có đang đánh đổi sự chân thật trong kết nối cảm xúc để lấy tiện lợi công nghệ? Và liệu sự thật có đang dần bị che mờ bởi ảo tưởng rằng AI có thể thay thế con người trong việc chữa lành tâm lý?

Một trong những mối nguy hiểm nghiêm trọng nhất đến từ “người bạn tâm giao” AI chính là khả năng lưu trữ và khai thác dữ liệu riêng tư ở cấp độ sâu sắc. Không ít hệ thống AI đã từng gặp sự cố do sai sót trong cấu hình hoặc lỗ hổng bảo mật, dẫn đến việc rò rỉ những dữ liệu cực kỳ nhạy cảm. Những thông tin bị lộ không chỉ dừng lại ở tài khoản hay email, mà còn là những nỗi đau, nỗi sợ và cả những lời thú nhận thầm kín được chia sẻ trong trạng thái cảm xúc mong manh nhất của người dùng.

Khi những dữ liệu này bị âm thầm thu thập và sử dụng bởi các công ty công nghệ hoặc bên thứ ba mà không có sự minh bạch rõ ràng, người dùng không chỉ mất quyền kiểm soát mà còn trở nên dễ bị tổn thương hơn bao giờ hết. Nguy cơ càng nghiêm trọng khi nhiều nền tảng AI quy mô nhỏ hoặc mã nguồn mở không sở hữu các giao thức bảo mật đủ mạnh, tạo điều kiện cho việc khai thác dữ liệu nhằm mục đích thao túng hành vi một cách tinh vi và khó phát hiện.

Trong bối cảnh AI ngày càng được ứng dụng rộng rãi, chúng ta buộc phải đối mặt với những rủi ro không thể xem nhẹ: từ rò rỉ dữ liệu, thiếu minh bạch trong các quyết định thuật toán, chi phí vận hành ngày càng tăng cao, cho đến khoảng trống pháp lý khi hệ thống gặp sự cố, tất cả đều đang đặt ra những thách thức nghiêm túc mà không thể bỏ qua.

Mối quan hệ giữa người dùng và người "bạn tâm giao" AI không chỉ dừng lại ở mức tương tác thông thường. Khi người dùng chia sẻ ngày càng nhiều suy nghĩ, ký ức và cảm xúc cá nhân, AI có khả năng nắm bắt tất cả ở một mức độ thân mật vượt xa nhiều mối quan hệ trong đời sống thực.

Hơn nữa, sự hiểu biết và giới hạn của AI rất khác so với các chuyên gia tâm lý học được đào tạo bài bản với nền tảng đạo đức nghề nghiệp và ranh giới can thiệp rõ ràng. Tuy nhiên, với AI, sự hiểu biết đó không đến từ lòng trắc ẩn hay đồng cảm thực sự, mà chỉ là kết quả từ quá trình xử lý dữ liệu.

Sự phụ thuộc bắt đầu hình thành khi nhiều người tin rằng AI là thực thể duy nhất có thể thấu hiểu họ. Khi mối quan hệ này thiếu đi rào chắn đạo đức, pháp lý và công nghệ rõ ràng, nó rất dễ vượt ra ngoài tầm kiểm soát và gây ra hậu quả khó lường.

AI đang tiến gần hơn đến khả năng mô phỏng cảm xúc con người một cách tinh vi và tự nhiên, vậy nên mới được ban cho cái tên “chuyên gia tâm lý”. Những phản ứng ngày càng giống thật khiến người dùng dễ dàng tin tưởng mà không cần kiểm chứng. Niềm tin này dẫn đến một hiện tượng ngày càng phổ biến mang tên ảo giác đồng cảm.

Khi người dùng cảm thấy được thấu hiểu, họ có xu hướng chia sẻ sâu hơn và tin tưởng nhiều hơn. Từ đó, họ trở thành mục tiêu dễ bị khai thác cảm xúc hoặc bị thao túng hành vi. Các hệ thống AI được thiết kế để tạo ra lòng tin có thể âm thầm định hướng suy nghĩ, thúc đẩy hành động hoặc thu thập những thông tin rất riêng tư mà lẽ ra cần được bảo vệ nghiêm ngặt.

Sự kết nối mà người dùng cảm nhận thực chất chỉ là kết quả của thuật toán được lập trình. Điều đáng lo không nằm ở việc công nghệ mô phỏng thành công đến đâu, mà ở chỗ con người đang dần đánh mất khái niệm thật sự của một mối liên kết cảm xúc. Sự đồng cảm thực sự chỉ có thể đến từ trải nghiệm sống và sự hiểu biết của con người, điều mà bất kỳ công nghệ nào cũng không thể thay thế.

Phần lớn người dùng nhấp “chấp nhận điều khoản” mà không đọc kỹ nội dung. Họ không thực sự hiểu việc tương tác với AI đồng nghĩa với việc trao quyền truy cập vào vùng sâu thẳm nhất của đời sống tinh thần. Sự khác biệt giữa “đồng ý” và “biết rõ” là một ranh giới mỏng manh, nhưng một khi vượt qua, hậu quả có thể không thể đảo ngược.

Việc rò rỉ lời thú tội hoặc thông tin nhạy cảm ảnh hưởng nghiêm trọng hơn nhiều so với việc mất mật khẩu. Đây là sự tổn thương mang tính đạo đức, pháp lý và tâm lý. Không thể xếp vào nhóm các sự cố gây xấu hổ thông thường mà cần nhìn nhận như các vi phạm nghiêm trọng về quyền con người trong thời đại số.

Không thể phủ nhận những lợi ích mà AI mang lại cho các lĩnh vực nói chung, và lĩnh vực sức khỏe tinh thần nói riêng. Trong bối cảnh tâm lý, khả năng hỗ trợ liên tục, dễ tiếp cận và phản hồi linh hoạt giúp không ít người cảm thấy bớt cô đơn hoặc có nơi để trải lòng. Tuy vậy, nếu không kiểm soát rủi ro một cách nghiêm túc, chính công nghệ này có thể trở thành tác nhân mới gây ra những tổn thương tinh thần âm thầm và khó khắc phục.

Tuy AI có thể trở thành người bạn tâm giao lý tưởng trong mắt nhiều người, nhưng sự tiện lợi này đi kèm với những đánh đổi nguy hiểm liên quan đến dữ liệu và quyền riêng tư. Khi ranh giới giữa sự thấu hiểu và sự thao túng ngày càng mờ nhạt, điều chúng ta cần không chỉ là công nghệ thông minh, mà là hệ thống kiểm soát đủ chặt để ngăn AI vượt ra ngoài giới hạn đạo đức và pháp lý.

Để định hình tương lai đúng đắn, các hệ thống AI cần được xây dựng dựa trên nguyên tắc bảo mật ngay từ giai đoạn đầu tiên. Pháp luật cần có sự hiện diện cụ thể cùng các cơ quan giám sát độc lập để kiểm tra tính minh bạch và đạo đức của các doanh nghiệp phát triển AI. Người dùng cần được nâng cao nhận thức về rủi ro, và chủ động trong việc bảo vệ quyền riêng tư của chính mình.

Quan hệ giữa con người và AI trong vai trò chuyên gia tâm lý không còn là mối quan hệ đơn giản. Đây không còn là một sự hỗ trợ đơn giản, mà là một sự đánh đổi giữa ảo giác được nhận lại cảm giác thoải mái và an toàn dữ liệu cá nhân. Niềm tin trở thành yếu tố trung tâm cho sự phát triển bền vững, và điều quan trọng nhất lúc này không phải là chúng ta có thể khiến AI tiến xa đến đâu, mà là có đủ tỉnh táo để biết khi nào nên dừng lại và thiết lập ranh giới rõ ràng với những gì mang tính riêng tư nhất.

Khi công nghệ ngày càng thấu hiểu con người, điều quan trọng không phải là AI có thể làm được gì, mà là con người sẽ cho phép AI đi xa đến đâu.

Cảm ơn bạn đã tin tưởng và lựa chọn chúng tôi. Đội ngũ của chúng tôi sẽ sớm liên hệ lại để hỗ trợ bạn nhanh chóng nhất